Filozof John Searle, ünlü “Çin Odası Argümanı” ile yapay zekânın düşünme yetisine sahip olamayacağını, yalnızca bilişi taklit edebileceğini savunur.

Yapay zekâ, çok çeşitli alanlarda kullanılmaya başlanarak giderek daha yaygın hale geldi. Sürücüsüz araçlardan ödüllü resimler üretmeye, milyarlarca tweet’i analiz etmeye ve hatta (ironik bir şekilde) tam makaleler yazmaya kadar pek çok uygulamada karşımıza çıkıyor.

Dijital veri üretimindeki patlama ve bilgisayar gücündeki ilerlemeler, günlük hayatımızı ve zeka kavramına bakışımızı köklü biçimde değiştirdi. Bazı akademisyenler, örneğin Yunan kökenli Amerikalı sosyolog Nicholas Christakis, yapay zekâyı insan etkileşimlerini sonsuza kadar dönüştürecek köklü teknolojilerden biri olarak tanımlamıştır.

Yine de önümüzde uzun bir yol olduğu açıktır. Önde gelen filozof John Searle, yapay zekânın asla insanlar gibi gerçek anlamda düşünemeyeceğini savunmuştur. Bu görüşünü göstermek için geliştirdiği ünlü “Çin Odası Argümanı”, çağdaş felsefede büyük etki yaratan tartışmalardan biri olmuştur.

Yapay Zeka ile Yapay Genel Zeka arasındaki fark nedir?

Bu noktada, Yapay Zekâ (AI) ile Genel Yapay Zekâ (AGI) arasındaki ayrımı yapmak faydalıdır. Bugün çoğumuz, dar bir anlamda insan zekâsını taklit eden sistemlerle etkileşim kuruyoruz. Örneğin, bir yapay zekâ milyarlarca kelimeyi analiz etmekte çok başarılı oluyor. Ancak basit bir espriyi anlamakta hala yetersiz kalıyor.

Ya da mükemmel bir sürücü veya satranç oyuncusu olsa da, henüz bu iki yeteneğe aynı anda sahip olamıyor. Yapay zekânın temel sınırlaması, esnek öğrenme yeteneğinden yoksun olmasıdır. Oysaki yapay genel zeka dediğimiz zamanlar da yeni görevleri hızla öğrenebilen, farklı görevler arasındaki analojileri görebilen ve yeni sorunları esnek bir şekilde çözebilen bir üst sınıftan bahsediyoruz.

Peki yapay genel zekanın var olması mümkün mü? Bu tartışmada, böyle bir zekânın iyi ya da kötü olup olmayacağı değil, böyle bir zekânın mümkün olup olamayacağı sorusu ön plandadır. Searle, Çin Odası düşünce deneyini bu soruya bir cevap vermek için yapmıştı.

Çin odası düşünce deneyi nedir?

Filozof John Searle, Wittgenstein’ın geç dönem felsefesinden etkilenerek, bu sorunu Minds, Brains, and Science (1984) adlı kitabında ele aldı. Searle, bilgisayar programlarının insan zihinsel süreçlerini yalnızca biçimsel olarak taklit edeceğini savundu. Başka bir deyişle, yapay zeka, sadece belirli kuralları (algoritmaları) izler; ancak bu kurallara anlam yüklemez.

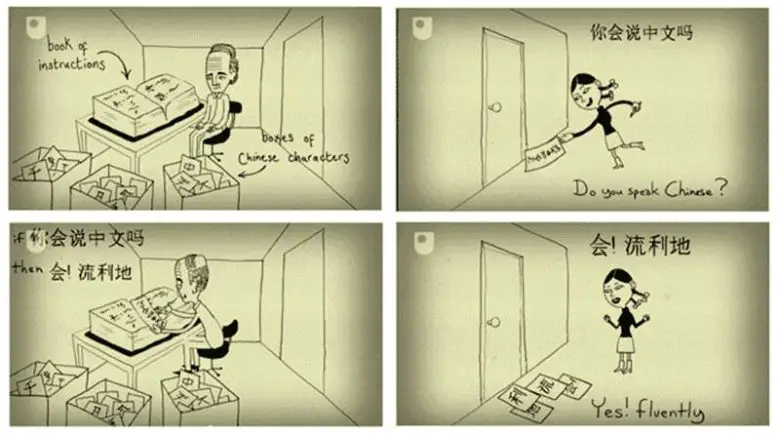

Bu görüşünü somutlaştırmak için Searle, Çin Odası düşünce deneyini geliştirdi. Bize, Çin karakterleriyle dolu sepetlerin bulunduğu bir odada kilitli olduğumuzu hayal etmemizi ister. Odada, kendi anadilimizde yazılı bir kural kitabı var. Bu kitap, Çin karakterleriyle nasıl işlem yapılacağını anlatır. Kurallar şuna benzer: “Eğer [X] sembolünü görürsen, [Y] sembolüyle yanıt ver.” Bu süreçte, kullanılan sembollerin anlamı hakkında hiçbir bilgi sahibi olmayız.

Daha sonra, odanın dışındaki bir kişi, kapının altından bazı Çin karakterleri uzatır. Biz de, sepetlerden karakterler seçerek ve kural kitabındaki talimatlara uyarak cevap hazırlarız ve bu yanıtları dışarı göndeririz. Talimatlar o kadar açık ve ayrıntılıdır ki, verdiğimiz yanıtlara bakarak dışarıdaki kişi artık bizim Çince bildiğimizi sanır.

Bu benzetmeyle, yapay zekânın durumu da açıklanır. Yapay zekâ, insanlar gibi anlam yükleyerek değil, yalnızca semboller üzerinde biçimsel işlemler yaparak çalışır. Searle bunu şöyle ifade eder. “Bir dili anlamak, sadece bir grup biçimsel sembole sahip olmak değildir. O sembollere bir yorum veya anlam atamak gerekir”

Teknolojik ilerlemeler süreci değiştirecek mi?

Peki ya teknolojik ilerlemeler? Bu sınırlamaları sonunda aşamaz mı? Makine öğrenmesi algoritmaları giderek daha karmaşık hale geliyor ve internet üzerinden toplanan veri miktarı da katlanarak artıyor. Bir yapay zekânın dili yalnızca taklit etmekle kalmayıp gerçekten anlayacağı günler, sadece bir zaman meselesi gibi gözüküyor. Burada soru “nasıl” değil, “ne zaman” olur.

Bu görüşe karşı çıkanlardan biri de Oxford Üniversitesi profesörü Luciano Floridi’dir. Ona göre, bu durum sıfırla çarpma işlemine benzer. Ne kadar büyük bir sayı kullanırsanız kullanın, sonuç her zaman sıfır olacaktır. Talimat kitabı ne kadar kalın ve karmaşık hale gelirse gelsin, odadaki kişi yine de Çin dilini anlamayacaktır.

Öte yandan farklı bir bakış açısı da mümkündür. Çin Odası’nda esas nokta, odanın dışındaki insanların sizin Çince bildiğinize inanmasıdır. Belki de önemli olan budur. Yapay zekâ kuramının öncülerinden Alan Turing’e göre, eğer biri bir insan ile makineyi ayırt edemiyorsa, program amacına ulaşmıştır.

Büyük ihtimalle, bankanızda ya da sipariş verdiğiniz bir restoranın müşteri hizmetlerinde bir sohbet botu ile iletişim kurmuşsunuzdur. Alan Turing’in ifadesiyle, bu bir “taklit oyunudur”. Ancak, taklit oyunu yeterli değildir.

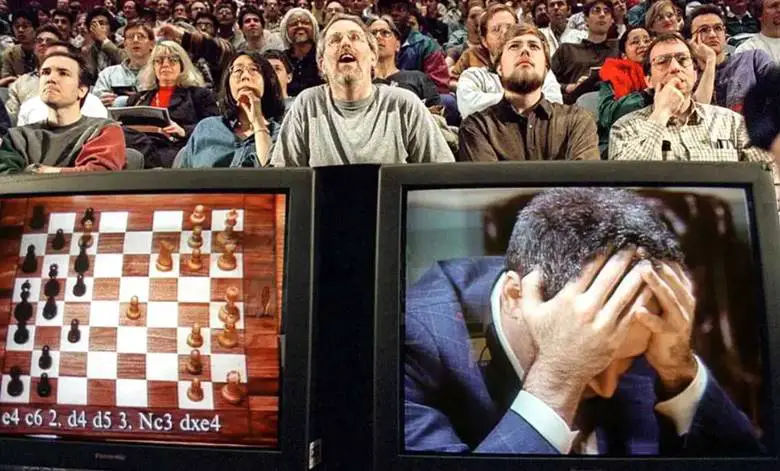

Daha önce belirtildiği gibi, yapay zekâ algoritmaları bazı görevlerde insanlardan daha iyi performans gösterebilir. Fakat bu onların gerçekten düşündüğü veya sürekli öğrendiği anlamına gelmez. Derin öğrenme ağları satranç veya Go gibi oyunları oynayabilir, hatta bilgi yarışmalarında zafer kazanabilir. Yine de bu sistemlerin hiçbiri, oynadıkları şeyin bir oyun olduğunun farkında değildir.

Çin Odası Deneyi Neyi Kanıtladı?

Tüm bu bilgiler ışığında, Searle’ın Çin Odası deneyindeki argümanı geçerliliği korunuyor. IBM’in Deep Blue bilgisayarı 1997 yılında Garry Kasparov’u yendiğinde, satranç büyükustası şunları söylemişti: “Yapabildiğimiz her şeyi (…) makineler bizden daha iyi yapacak (…) Eğer bir işi kodlayabiliyorsak ve bilgisayarlara aktarabiliyorsak, makineler onu daha iyi yapar.” Kasparov’un sözlerinde önemli bir ipucu bulunuyor: Eğer kodlayabiliyorsak.

Sorun şu ki, insan zekâsının nasıl işlediğini, özellikle dil yeteneğinin nasıl geliştiğini henüz tam anlamıyla bilmiyoruz. Bilişimizin birçok yönü hâlâ bilinmezliğini koruyor. Yani henüz bu süreçleri kodlayacak bilgiye sahip değiliz. Bu durumda, Yapay Genel Zekâ’ya giden yol, belki de beynin nasıl çalıştığına dair eksik bilgimiz nedeniyle kapalıdır.

Jeff Hawkins, A Thousand Brains (2021) adlı kitabında bu yaklaşımı savunur. Ona göre, bir Yapay Genel Zekâ, insan beyninin çalışmasına benzer şekilde işlemelidir. Bu da, dünyada gezinme ve etkileşim kurabilme yeteneğini, yani bir bedenin varlığını gerektirir. Çünkü öğrenme, dokunarak, hareket ederek, görerek, işiterek, tadına bakarak ve çevreyi keşfederek gerçekleşir.

Bu bedenin insan biçiminde olması şart değildir. Önemli olan çevreyi keşfecek ve içinde hareket edecek bir yapıya sahip olmasıdır. Bu nedenle, sinirbilimciler, robotik araştırmacılar ve yapay zeka geliştiricilerinin iş birliği içinde çalışması gereklidir. Bu anlayış, felsefi açıdan René Descartes’ın eski düalizmine karşı bir duruş sergiler: Bedensiz düşünmek mümkün değildir.

Kaynaklar ve İleri Okumalar:

- Britannica, The Editors of Encyclopaedia. “Chinese room argument”. Encyclopedia Britannica, 19 Jul. 2024, https://www.britannica.com/topic/Chinese-room-argument. Accessed 18 September 2024.

- Can AI Think? Searle’s Chinese Room Thought Experiment. Yayınlanma tarihi: 16 Ocak 2023; Bağlantı: https://www.thecollector.com/

Size Bir Mesajımız Var!

Matematiksel, matematiğe karşı duyulan önyargıyı azaltmak ve ilgiyi arttırmak amacıyla kurulmuş bir platformdur. Sitemizde, öncelikli olarak matematik ile ilgili yazılar yer almaktadır. Ancak bilimin bütünsel yapısı itibari ile diğer bilim dalları ile ilgili konular da ilerleyen yıllarda sitemize dahil edilmiştir. Bu sitenin tek kazancı sizlere göstermek zorunda kaldığımız reklamlardır. Yüksek okunurluk düzeyine sahip bir web sitesi barındırmak ne yazık ki günümüzde oldukça masraflıdır. Bu konuda bizi anlayacağınızı umuyoruz. Ayrıca yazımızı paylaşarak da büyümemize destek olabilirsiniz. Matematik ile kalalım, bilim ile kalalım.

Matematiksel