Filozof John Searle, yapay zekânın asla insanlar gibi gerçek anlamda düşünemeyeceğini savunmuştur. Bu görüşünü göstermek için geliştirdiği ünlü “Çin Odası Argümanı”, çağdaş felsefede büyük etki yaratan tartışmalardan biri olmuştur.

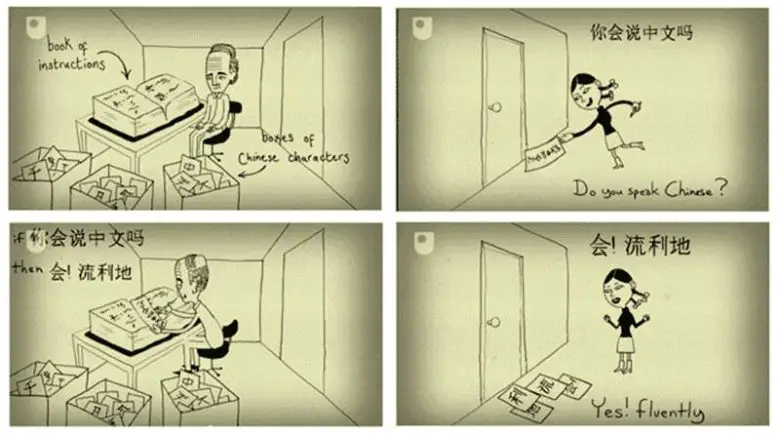

Kapısı kapalı, penceresiz bir odada tek başınasınız. Odada bir kural kitabı ve üzerleri size tamamen yabancı işaretlerle dolu kâğıt yığınları var. Bu işaretler sizin için hiçbir anlam taşımıyor; hatta bir dile ait olup olmadıklarını bile bilmiyorsunuz. Gördüğünüz şeyler sadece anlamsız şekillerden ibaret.

Kural kitabını açtığınızda, sayfalar boyunca uzanan tekdüze talimatlarla karşılaşıyorsunuz. Hepsi aynı kalıpta yazılmış: “Eğer şunu görürsen, şunu yap.” Boşlukların içi, yerdeki kâğıtlarda yazılı olan o garip işaretlerle doldurulmuş.

Bir süre sonra kapının altındaki yarıktan bir kâğıt içeri kayıyor. Üzerinde yine o tanıdık ama anlamsız semboller var. Kitaba bakıyorsunuz, işaretlerin birebir karşılığını bulana kadar sayfaları çeviriyorsunuz. Nihayet bir kural eşleşiyor. Talimat açık: Şu işaretleri bul, karşılık gelen kâğıdı al ve dışarı ver. Söyleneni aynen yapıyorsunuz; doğru kâğıdı bulup yarıktan dışarı itiyorsunuz.

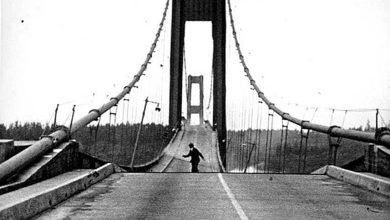

Şimdi bir adım daha ileri gidelim. Diyelim ki odadaki kâğıtlara ve kural kitabına kazınmış o anlamsız işaretlerin aslında Mandarin Çincesine ait karakterler olduğunu öğrendiniz. Odanın dışındaki kişi için durum bambaşkadır. O kişi, içeri kâğıtlar gönderirken, karşısında Mandarin’i akıcı biçimde konuşan biri varmış gibi bir izlenim edinir.

İşte bu sahne, filozof John Searle’ün ortaya attığı ve “Çin Odası” olarak bilinen düşünce deneyidir. Searle’e göre, odanın içindeyken siz, bir program çalıştıran bir bilgisayarla eşdeğersiniz.

Programınız o kadar kusursuzdur ki, dışarıdaki birini Mandarin bildiğinize ikna etmeyi başarırsınız. Mandarin için Turing Testi’ni geçmiş olursunuz. Ancak siz Mandarin bilmiyorsunuz. Karakterlerin ne anlama geldiğini anlamıyorsunuz. Yalnızca sembolleri başka sembollerle değiştiriyorsunuz.

Çin Odası Deneyi Neyi Kanıtladı?

Bugün çoğumuz, insan zekâsını dar bir çerçevede taklit eden sistemlerle iç içe yaşıyoruz. Bir yapay zekâ, milyarlarca kelimeyi tarayıp örüntüler yakalayabiliyor; devasa veri kümeleri üzerinde neredeyse kusursuz sonuçlar üretebiliyor. Ama basit bir espriyi çoğu zaman kaçırıyor.

Usta bir satranç oyuncusu olabiliyor ya da hatasız bir sürücü gibi davranabiliyor; fakat bu iki yeteneği aynı anda birleştiremiyor. Çünkü bugünkü yapay zekâların temel sınırı, esnek öğrenmeden yoksun olmalarıdır. Her biri dar bir alanda ustalaşır, ama o alanın dışına adım atmakta zorlanır.

İşte “yapay genel zekâ” dediğimiz şey tam da burada devreye girer. Yeni görevleri hızla öğrenebilen, farklı alanlar arasında benzerlikler kurabilen, daha önce hiç karşılaşmadığı sorunları esnek biçimde çözebilen bir zekâdan söz ederiz.

Asıl tartışma da burada başlar: Böyle bir zekâ gerçekten mümkün müdür? John Searle’ün Çin Odası düşünce deneyi tam da bu noktada sahneye çıkar.

Bir odada, hiç anlamadığınız sembollerle çalışan biri olduğunuzu hatırlayın. Elinizde yalnızca kurallar vardır. Semboller girer, semboller çıkar. Dışarıdan bakan biri, içeride Mandarin bilen biriyle konuştuğunu sanır. Oysa içerideki kişi hiçbir şey anlamıyordur; yalnızca kuralları izliyordur.

Searle’e göre bugünkü yapay zekâlar da tam olarak böyledir. Ne kadar hızlı, ne kadar kusursuz çalışırlarsa çalışsınlar, yaptıkları şey anlamak değil, sembolleri başka sembollerle eşleştirmektir.

Bu nedenle Searle, “sözdizim anlambilim için yeterli değildir” der. Yani kurallar, hesaplamalar ve programlar tek başına anlam üretmez. Bir sistem, dışarıdan bakıldığında ne kadar zeki görünürse görünsün, bu onun gerçekten anladığı anlamına gelmez.

Çin Odası Deneyine Yapılan İtirazlar Nelerdir?

John Searle’ün Çin Odası düşünce deneyi, güçlü yapay zekâ iddiasına yöneltilmiş en etkili eleştirilerden biri olarak kabul edilir. Ancak bu etki, deneyi tartışmasız kılmaz; aksine çok sayıda güçlü itirazın da ortaya çıkmasına yol açmıştır. Bu itirazlar, genellikle Searle’ün anlamayı yanlış yerde aradığı ya da zihni aşırı basitleştirilmiş bir modelle ele aldığı iddiası etrafında toplanır.

En bilinen eleştiri Sistem Yanıtıdır. Bu yaklaşıma göre, Çin Odası’nda anlama yetisini yalnızca içerideki kişide aramak hatalıdır. Anlama, kişiyle kural kitabının birlikte oluşturduğu bütün sisteme aittir. İçerideki kişi tek başına Mandarin’i anlamıyor olabilir; ancak sistem bir bütün olarak anlamlı yanıtlar üretebiliyorsa, ortada bir tür anlama vardır. Searle bu itiraza, kişinin tüm kural kitabını ezberlediği senaryoyla karşılık verir; fakat eleştirmenlere göre bu yanıt, anlamın dağıtık doğasını göz ardı eder.

Bir diğer önemli itiraz Robot Yanıtıdır. Buna göre Çin Odası’nın temel eksiği, dünyayla hiçbir etkileşiminin olmamasıdır. Anlam, sembollerin gerçek nesnelerle ve durumlarla ilişkilendirilmesini gerektirir. Eğer sistem algı organlarına sahip olsaydı, semboller dünyaya bağlanabilir ve gerçek anlama ortaya çıkabilirdi. Searle, odayı sensörlerle donatılmış bir robotun içine yerleştirerek bu itiraza da karşı çıkar; ancak bu hamle, pek çok kişi için sezgisel gücünü zayıflatır.

Paul ve Patricia Churchland’ın öne sürdüğü yapısal eleştiri ise deneyi daha temelden hedef alır. Onlara göre Çin Odası, beynin nasıl çalıştığını yanlış temsil eder. İnsan zihni, tek tek sembolleri sırayla işleyen bir sistem değil; çok sayıda sürecin aynı anda yürüdüğü paralel bir yapıdır. Bu nedenle sembol işleme yerine bağlantıcı ağlara dayalı modeller, zihni anlamak için daha elverişlidir.

Sonuç Olarak

Bu itirazlar, Çin Odası’nı geçersiz kılmaktan çok, “anlama” dediğimiz şeyin nerede ve nasıl ortaya çıktığı sorusunu daha da keskinleştirir. Tartışmanın bitmemesinin nedeni de budur: Çin Odası, kesin cevaplar vermekten ziyade, zihin hakkındaki temel varsayımlarımızı açığa çıkarır.

Kaynaklar ve İleri Okumalar:

- Britannica, The Editors of Encyclopaedia. “Chinese room argument”. Encyclopedia Britannica, 19 Jul. 2024, https://www.britannica.com/topic/Chinese-room-argument. Accessed 18 September 2024.

- Can AI Think? Searle’s Chinese Room Thought Experiment. Yayınlanma tarihi: 16 Ocak 2023; Bağlantı: https://www.thecollector.com/

Matematiksel